Нейросеть воссоздала человеческую речь по активности мозга

Специалисты из Нью-Йоркского университета создали нейросеть, способную анализировать нейронную активность коры головного мозга и по ней реконструировать речь человека. Более того, ученые дополнительно обучили сеть воспроизводить голос пациента по нескольким образцам голосовых или видеозаписей, позволяя людям вернуть свой голос даже после его потери.

Человеческая речь — это сложная поведенческая активность, которая включает в себя не только управление движениями множества ротовых, гортанных и дыхательных мышц, но и одновременную обработку собственной речи для ее корректировки. Разделение разветвленных нейронных сетей мозга, контролирующих точные движения мышц и обрабатывающих слуховую обратную связь, признают крайне сложной задачей. Однако ее необходимо решить для разработки речевых протезов следующего поколения.

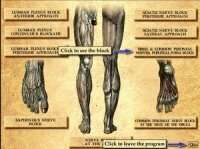

Во многих моделях производства речи принято считать, что эти две системы анатомически разделены. Система прямой связи в основном управляется вентральной лобной корой, тогда как обработка обратной связи осуществляется через различные сенсорные зоны коры (например, через извилину Гешля и верхнюю височную извилину). Но на практике две сети нейронов значительно перекрываются и взаимодействуют, и даже самые современные методы электрокортикографии (запись биоэлектрической активности мозга с помощью регистрации сигналов с сети электродов, имплантированных в кору головного мозга) не способны отделить процессы производства речи от ее обработки.

В новой работе группа исследователей из США представила собственную архитектуру нейросети глубокого обучения, тренирующуюся на электрокортикографических (ЭКоГ) записях активности коры головного мозга человека для пространственного и временного разрешения моторных и сенсорных сигналов. Обучая нейросеть применять причинные (использующие текущие и прошлые нейронные сигналы), антипричинные (использующие текущие и будущие нейронные сигналы) или непричинные (их комбинацию) временные свертки, авторам исследования удалось реконструировать человеческую речь. О своей разработке коллектив ученых рассказал в статье, опубликованной в журнале Proceedings of the National Academy of Sciences.

Исследователи использовали нейросеть для создания собственных протезов, которые смогут считывать активность мозга и декодировать ее непосредственно в речь. Более того, прототип специалистов из Нью-Йоркского университета имеет еще одну особенность: он способен в значительной степени воссоздать голос пациента, используя лишь небольшой набор записей — например, с видео на YouTube или записи Zoom.

Для сбора данных и тестирования своего прототипа исследователи обратились к группе из пяти пациентов с диагностированной рефрактерной эпилепсией и нарушениями развития речи. В этом состоянии пациент, страдающий судорожными припадками, не реагирует на лечение противоэпилептическими препаратами в адекватных дозах и комбинациях, а значит, не поддается медикаментозному лечению.

Этим пациентам имплантировали в левое полушарие мозга сетку из 64 стандартных субдуральных (помещаемых на поверхность коры головного мозга) электродов ЭЭГ для мониторинга их состояния в течение недельного эксперимента. Кроме того, им устанавливали дополнительные 64 электрода меньшего размера, чередующиеся между обычными клиническими электродами для повышения пространственного разрешения считываемого сигнала. Имплантированная ЭКоГ-матрица предоставила исследователям ключевую информацию о деятельности мозга во время процесса произнесения речи, что позволяло с высокой точностью ее декодировать.